گروهی از پژوهشگران دانشگاه ماساچوست و بخش اخلاق کاربردی این دانشگاه با بررسی تعامل ایجاد شده بین انسان و هوش مصنوعی هشدار دادند کاربران نباید این فناوری ها را مانند یک انسان در نظر بگیرند.

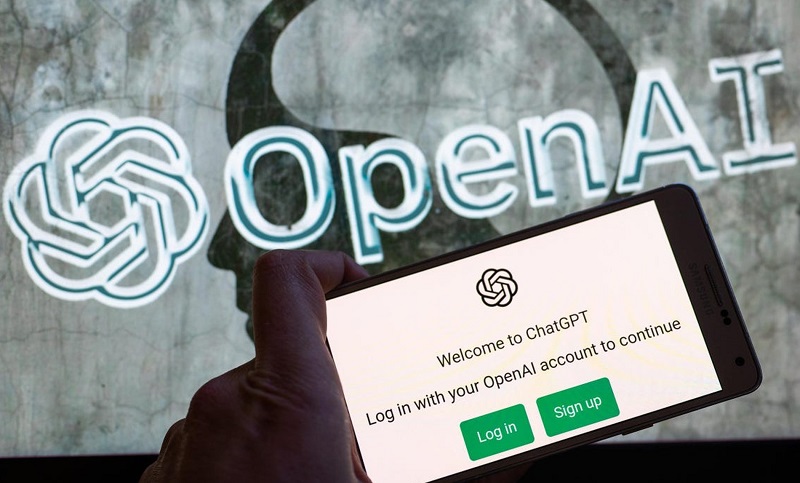

به گزارش سرویس اخبار فناوری و تکنولوژی تکنا، هوش مصنوعی ChatGPT و مدل های زبانی که اخیراً بسیار توسعه یافته اند میتوانند به پرسشهای بیپایان پاسخ دهند. البته قابلیت های هوش مصنوعی اخیراً سوال قدیمی در مورد این فناوری را مطرح کرده است که آیا امکان هوشیار شدن این فناوری وجود دارد یا خیر.

در سال ۲۰۲۲ یکی از مهندسان گوگل پس از تعامل با چت بات این شرکت اعلام کرد که فناوری هوش مصنوعی اکنون هوشیار است. پس از آن نیز روزنامه نگار نیویورک تایمز یک گفتگو با چت بات جدید بینگ منتشر کرد که در آن پاسخ های دریافتی از هوش مصنوعی باعث نگرانی این روزنامه نگار شده بود. در حال حاضر نیز بسیاری از مردم در مورد آگاهی هوش مصنوعی و احساسات ماشینی ابراز نگرانی می کنند.

پژوهشگران مرکز اخلاق کاربردی دانشگاه بررسی هایی را در مورد تاثیر تعامل با هوش مصنوعی بر درک افراد انجام داده اند. آنها در این تحقیق به دنبال منبع ترس ایجاد شده از فناوری های هوش مصنوعی در مردم بودند. به سادگی می توان فهمید که این احساس ترس از احساسات ماشینی مربوط به کنار گذاشتن کنترل انسان روی هوش مصنوعی و به دست گرفتن زندگی خود توسط این فناوری است که در فرهنگ عامه آنها را به فکر کردن درباره این موضوع مجبور کرده است.

از طرفی سخنان افرادی مانند ایلان ماسک و استیون هاوکینگ فیزیکدان انگلیسی در مورد توسعه هوش مصنوعی به عنوان بزرگترین تهدید در آینده بشریت نگرانی ها را نیز بیشتر کرده است. در هر صورت این نگرانی ها تا جایی که به مدل های زبانی بزرگ مربوط خواهد شد بی اساس است. زیرا چت جی پی تی و فناوری های شبیه به آن تنها برنامه هایی برای تکمیل جملات هستند و پاسخ های آنها نیز نشان دهنده قابل پیش بینی بودن انسان ها و برقراری ارتباط با آنها در صورت داشتن اطلاعات کافی است.

پیشنهاد ویژه |

29th November 25